Wat is effectief altruïsme?

Effectief altruïsme (EA) is een filosofie en een gemeenschap gericht op het zo effectief mogelijk helpen van mens en dier door middel van impactvolle carrières, projecten of donaties.

Effectief altruïsme (EA) is een filosofie en een gemeenschap gericht op het zo effectief mogelijk helpen van mens en dier door middel van impactvolle carrières, projecten of donaties.

Veel Nederlanders delen onze ambitie om iets goeds te doen voor de wereld, maar nog maar weinig mensen denken hier ook echt systematisch over na. Effectief Altruïsme is ontstaan uit een verlangen om filantropie professioneler en meer doelgedreven te maken. Dit begint bij beter onderzoek naar wat werkt en wat nodig is. Met feitelijke onderbouwing en weloverwogen argumenten kunnen mensen betere beslissingen maken over hoe ze hun tijd en geld voor het goede inzetten.

Het volgen van deze ideeën heeft de gemeenschap van Effectief Altruïsme geholpen veel te bereiken.

We hebben honderdduizenden sterfgevallen door verwaarloosde ziekten voorkomen door aanzienlijke financiering te verstrekken aan organisaties zoals de Against Malaria Foundation en Helen Keller International.

We hebben instituten opgericht die onderzoeken wat wereldwijd de grootste problemen zijn en welke prioriteit moeten krijgen bij het oplossen ervan. Bijvoorbeeld het Global Priorities Institute van de Universiteit van Oxford dat werkt aan het identificeren van de meest urgente problemen en ideeën biedt voor hoe we ze kunnen oplossen.

We hebben aangedrongen op veiligere technologische vooruitgang door initiatieven te ondersteunen zoals CHAI, een onderzoeksgroep aan UC Berkeley die ervoor zorgt dat nieuwe kunstmatige intelligentietechnologieën de mensheid ten goede komen in plaats van onaanvaardbare risico’s te vormen.

We hebben gewerkt aan het verbeteren van dierenwelzijn door bedrijfscampagnes en wettelijke hervormingen te ondersteunen. Zo zijn meer dan 100 miljoen kippen uit legbatterijen bevrijd.

En nog veel meer!

De meesten van ons willen een verschil maken. We zien lijden, onrecht en dood, en willen daar iets aan doen. Maar uitzoeken wat dat ‘iets’ is, laat staan het daadwerkelijk doen, kan een moeilijke en ontmoedigende uitdaging zijn. Effectief altruïsme is een antwoord op deze uitdaging. Het is een onderzoeksveld dat gebruik maakt van hoogwaardig bewijs en zorgvuldig redeneren om uit te zoeken hoe anderen zoveel mogelijk kunnen worden geholpen. Het is ook een gemeenschap van mensen die deze antwoorden serieus nemen, door hun inspanningen te richten op de meest veelbelovende oplossingen voor ’s werelds meest urgente problemen.

Geschiedenis bevat veel voorbeelden van mensen die een enorme positieve impact op de wereld hebben gehad:

Deze mensen lijken misschien onherkenbare helden die enorm dapper of bekwaam waren, of die toevallig op het juiste moment op de juiste plaats waren. Maar veel gewone mensen kunnen ook een enorme positieve impact hebben op de wereld, als ze verstandig kiezen.

Dit is zo verbazingwekkend dat je je dit nauwelijks realiseert. Stel je voor dat je op een dag een brandend gebouw ziet met een klein kind erin. Je rent het gebouw in, pakt het kind op en brengt het in veiligheid. Je zou een held zijn.

Stel je nu voor dat dit je om de twee jaar overkwam – je zou tientallen levens redden in de loop van je leven. Dit klinkt als een vreemde wereld, toch?. Maar de feiten tonen aan dat dit wel de wereld is waarin veel mensen (kunnen) leven. Als je een gemiddeld inkomen verdient in Nederland (of in één van de andere ontwikkelde landen) en je elk jaar 10% van je inkomsten doneert aan de beste goede doelen van GiveWell, dan zal je tientallen levens redden.

Sterker nog, de wereld lijkt nog vreemder. Donaties zijn niet de enige manier om goed te doen: veel mensen hebben de kans om een grotere impact te hebben dan doneren aan wereldwijde liefdadigheidsinstellingen voor armoede. Hoe? Ten eerste, je kunt een loopbaan kiezen waarmee je veel maatschappelijke impact hebt door aan belangrijke problemen te werken. Ten tweede kunnen andere problemen dan wereldwijde armoede en gezondheid nog belangrijker zijn voor de wereld.

Bij veel onderwerpen in ons dagelijkse leven nemen beslissingen op basis van bewijs en argumenten in plaats van giswerk of onderbuik instinct. Wanneer je een telefoon koopt, lees je klantrecensies om de beste deal te krijgen. Je zult zeker geen telefoon kopen die 1.000 keer meer kost dan een identiek model.

Toch zijn we niet altijd zo kritisch als we aan mondiale problemen werken.

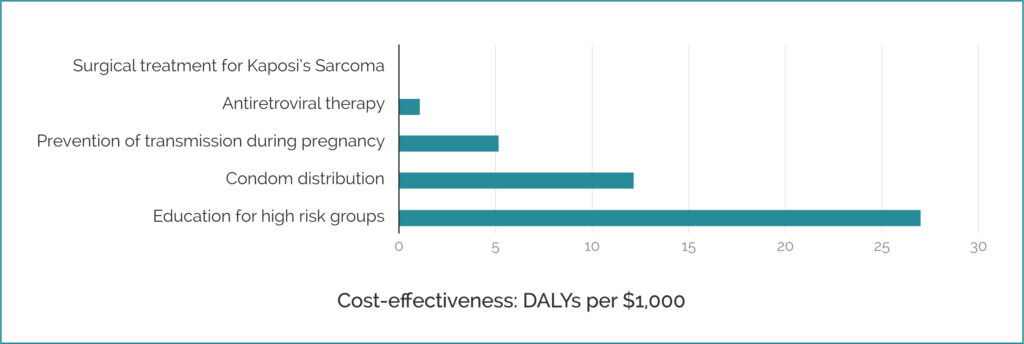

Hieronder staat een grafiek uit een essay van Dr. Toby Ord, waarin het aantal gezonde levensjaren wordt getoond welke je kunt realiseren door $ 1.000 te doneren voor een specifieke interventie om de verspreiding van HIV en AIDS te verminderen. De grafiek toont cijfers voor vijf verschillende strategieën (gemeten met behulp van DALY’s).

De impact van de eerste interventie, chirurgische behandeling, heeft dusdanig weinig effect ten opzichte van andere strategieën, dat het effect niet eens zichtbaar is. De beste strategie, het opleiden van risicogroepen, wordt geschat op 1.400 keer beter dan de chirurgische behandeling. (Het is mogelijk dat deze schattingen onnauwkeurig zijn of niet alle relevante effecten weergeven. Maar het lijkt waarschijnlijk dat er nog steeds grote verschillen zijn tussen interventies.)

We vermoeden dat het verschil in effectiviteit van interventies even groot is bij andere (wereld) problemen, hoewel we daar vaak niet zulke duidelijke gegevens hebben als voor interventies op het gebied van de wereldwijde gezondheid. Waarom denken we dit? Mede omdat de meeste projecten (in meeste domeinen waar we data voor hebben) geen significante positieve impact lijken te hebben. En, optimistischer, omdat het er op lijkt dat er enkele interventies zijn die een enorme impact hebben. Maar zonder te weten welke experts je moet vertrouwen, of welke technieken je moet vertrouwen in je eigen onderzoek, kan het heel moeilijk zijn om de interventies met grote impact er uit te vissen.

Welke interventies om goed te doen de grootste impact hebben, blijft een belangrijke open vraag. Het vergelijken van verschillende manieren om goed te doen is moeilijk, zowel emotioneel als praktisch. Maar het vergelijken van de impact van interventies is van wezenlijk belang om ervoor te zorgen dat we anderen zoveel mogelijk helpen.

De media richten zich vaak op negatieve verhalen.

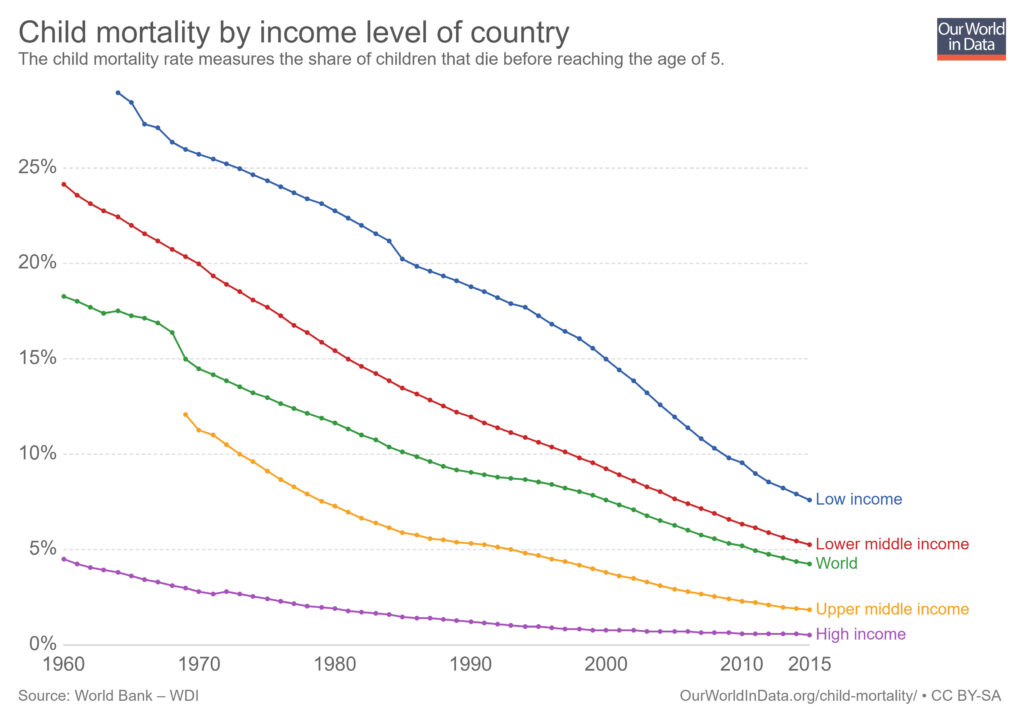

Maar in veel opzichten wordt de wereld beter. Gezamenlijke inspanningen om de wereld te verbeteren hebben al fenomenaal succes gehad. Laten we een paar voorbeelden bekijken. Het aantal mensen dat onder de armoedegrens van de Wereldbank leeft, is sinds 1990 meer dan gehalveerd. Ten tijde van de Koude Oorlog werden duizenden kernwapens over de Atlantische Oceaan verplaatst, maar we overleefden zonder een enkele nucleaire aanval. In de afgelopen paar eeuwen hebben we slavernij gecriminaliseerd, de onderdrukking van vrouwen drastisch verminderd en in veel landen veel gedaan om de rechten voor en acceptatie van mensen die homo, bi, trans of queer zijn.

Toch zijn er nog veel problemen. Ongeveer 700 miljoen mensen moeten leven van minder dan $ 2 per dag. Klimaatverandering en verkeerd gebruik van nieuwe technologieën hebben de potentie om miljarden mensen in de toekomst te schaden. Miljarden dieren lijden in de bio-industrie. Dierenwelzijn is een serieus moreel ethisch dilemma. Er zijn zoveel problemen. We moeten goed nadenken over welke problemen onze prioriteit verdienen om op te lossen. Het probleem waar je voor kiest om aan te werken bepaald in grote mate hoeveel goeds je kunt doen. Als je een probleem kiest waarbij het niet mogelijk is om heel veel mensen (of dieren) te helpen, of waarvoor geen goede manieren zijn om de relevante problemen op te lossen, dan zal je impact aanzienlijk beperkt blijven.

Hier tegen overstaat dat je een enorme impact kunt hebben als je een probleem kiest waar je veel hulp kunt bieden en waarbij je gebruikt van effect metingen om verschillende oplossingen met elkaar te kunnen vergelijken om zo de aanpak met de grootste impact te vinden. Sommige pogingen om het lijden van dieren te verminderen, blijken bijvoorbeeld ongelooflijk effectief te zijn. Door goed na te denken en strategisch te handelen, heeft een kleine groep actievoerders met beperkte budgetten geholpen om de levensomstandigheden van honderden miljoenen kippen die leden in de Amerikaanse bio-industrie te verbeteren.

Veel mensen zijn gemotiveerd om goed te doen, maar hebben al een doel gekozen voordat ze onderzoek naar de effectiviteit hebben doen. Daar zijn veel redenen voor, zoals persoonlijke ervaring met een probleem, of het hebben van een vriend die al geld inzamelt voor een bepaalde organisatie.

Maar als we een probleem kiezen dat toevallig op ons pad is gekomen en waar we een goed gevoel bij hebben, kunnen we de belangrijkste problemen van onze tijd over het hoofd zien. Gezien het feit dat de meeste interventies een lage impact lijken te hebben, zullen onze huidige niet weloverwogen acties niet erg impactvol zijn. We kunnen meer goed doen als we zorgvuldig nadenken over de vele problemen die er zijn en criteria bepalen om tot een keuze te komen om goed te doen.

De prioritering van problemen en de impact van interventies veranderen continu. Daarom moeten we open blijven staan voor nieuwe problemen, nieuwe feiten en argumenten. En indien nodig van strategie te veranderen om ons te richten op die problemen waar we het grootste verschil kunnen maken, zonder onszelf onnodig te beperken.

Hoe kunnen we er dan achter komen op welke problemen we ons moeten richten?

Onderzoekers hebben het volgende kader nuttig gevonden. Werken aan een oorzaak heeft waarschijnlijk een grote impact als het probleem:

Interventies voor de met dit kader geselecteerde problemen lijken bijzonder waarschijnlijk zeer impactvol te zijn.

De op deze manier geselecteerde problemen zijn niet in steen gebeiteld. Ze vertegenwoordigen gewoon de beste gissingen over waar we de meeste impact kunnen hebben, gezien het bewijsmateriaal dat momenteel beschikbaar is. Naarmate er nieuw bewijs aan het licht komt dat suggereert dat interventies bij andere problemen meer impact zullen hebben, moeten we overwegen om onze focus te verleggen en daar aan te gaan werken. Het is ook de moeite waard om in gedachten te houden dat als we naar een probleem gaan met potentieel meer impact, ook als we niet zeker weten of dit ook het beste probleem is om aan te werken, onze impact nog steeds veel groter kan zijn dan het hiervoor misschien was.

We zullen drie hoofd probleemgebieden bespreken: het verlichten van wereldwijde armoede, het verbeteren van dierenwelzijn en proberen de toekomst op lange termijn te beïnvloeden.

Ziekten die gepaard gaan met extreme armoede, zoals malaria en parasitaire wormen, doden elk jaar miljoenen mensen. Slechte voeding in lage-inkomenslanden kan leiden tot cognitieve stoornissen, geboorteafwijkingen en groeiachterstand.

Veel van dit lijden kan gemakkelijk worden voorkomen of verlicht. Muggennetten tegen malaria kosten ongeveer $ 2,00 per stuk. GiveWell, een onafhankelijke liefdadigheidsbeoordelaar, schat dat deze netten de malariacijfers aanzienlijk kunnen verminderen. En het simpelweg direct overmaken van geld naar mensen die erg arm zijn, is een relatief kosteneffectieve manier om mensen te helpen.

De verbetering van gezondheid voorkomt niet alleen het directe lijden dat gepaard gaat met ziekte en dood; het stelt mensen ook in staat om vollediger deel te nemen aan onderwijs en werk. Daardoor verdienen ze meer geld en hebben ze meer kansen op latere leeftijd.

De komst van de geïndustrialiseerde landbouw betekent dat miljarden dieren per jaar in onmenselijke omstandigheden worden gehouden in de bio-industrie. Van de meeste dieren wordt het leven voortijdig beëindigd omdat ze worden geslacht voor voedsel. Voorstanders van hun welzijn beweren dat het relatief goedkoop is om de vraag naar vlees uit de bio-industrie te verminderen, of om wetswijzigingen door te voeren die het welzijn van landbouwhuisdieren verbeteren. Vanwege de enorme aantallen dieren die ermee gemoeid zijn, zou het maken van vooruitgang op dit gebied een zeer grote hoeveelheid leed kunnen voorkomen.

Dierenwelzijn lijkt erg verwaarloosd, zeker gezien de omvang van het probleem. Slechts 3% van de filantropische financiering in de VS is verdeeld tussen het milieu en dieren, terwijl 97% gaat naar het helpen van mensen. En zelfs binnen de financiering die wordt besteed aan dierenwelzijn, gaat slechts ongeveer 1% naar landbouwhuisdieren, ondanks het extreme lijden waar ze mee te maken hebben.

Wil je meer weten over dierenwelzijn als collectieve prioriteit? Lees dit artikel over dierenwelzijn.

De meeste mensen geven niet alleen om de huidige generatie, maar ook om het behoud van de planeet voor toekomstige generaties.

Het aantal mensen dat in de (verre) toekomst nog zou kunnen leven is waarschijnlijk vele malen groter dan het aantal mensen dat vandaag leeft. Dit suggereert dat het uiterst belangrijk kan zijn om ervoor te zorgen dat het leven op aarde doorgaat en dat mensen in de (verre) toekomst een positief leven hebben.

Natuurlijk lijkt dit idee misschien contra-intuïtief: we denken niet vaak na over het leven van onze achterkleinkinderen, laat staan hun achterkleinkinderen. Maar net zoals we de benarde situatie van de wereldwijde armen niet moeten negeren alleen omdat ze in een vreemd land wonen, moeten we toekomstige generaties niet negeren alleen omdat ze minder zichtbaar zijn.

Helaas zijn er veel problemen die een zeer positieve toekomst op lange termijn bedreigen. Klimaatverandering en nucleaire oorlog zijn bekende bedreigingen voor het voortbestaan van onze soort op de lange termijn. Veel onderzoekers zijn van mening dat de risico’s van opkomende technologieën, zoals geavanceerde kunstmatige intelligentie en in laboratoria ontworpen ziekteverwekkers, nog zorgwekkender kunnen zijn. Natuurlijk is het moeilijk om precies te weten hoe technologieën zich zullen ontwikkelen, of te bedenken welke impact ze zullen hebben. Maar het lijkt erop dat deze technologieën de potentie hebben onze manier van leven de komende eeuwen radicaal te bepalen.

Vanwege de schaal van toekomstige generaties lijkt het waarschijnlijk dat de beste interventies op deze probleemgebieden nog meer impact zullen hebben dan interventies op het gebied van klimaatverandering en nucleaire oorlog.

Desondanks zijn existentiële risico’s die voortvloeien uit nieuwe technologieën verrassend verwaarloosd. Er zijn waarschijnlijk maar een paar honderd mensen in de wereld die werken aan risico’s van AI of gemanipuleerde pathogenen. Amerikaanse huishoudens besteden gemiddeld ongeveer 2% van hun budget aan persoonlijke verzekeringen. Als we een vergelijkbaar percentage van de wereldwijde middelen zouden besteden aan het aanpakken van risico’s voor de beschaving, zouden er miljoenen mensen aan deze problemen werken, met een budget van biljoenen dollars per jaar. Maar in plaats daarvan geven we slechts een klein deel van dat bedrag uit, ook al kunnen dergelijke risico’s de komende decennia aanzienlijk worden.

Als we ons individueel verzekeren tegen onwaarschijnlijke maar impactvolle gebeurtenissen, zouden we ons ook moeten beschermen tegen vreselijke uitkomsten collectief waarderen. Immers, een collectieve verschrikkelijke uitkomst, zoals het uitsterven van de mens, is ook verschrikkelijk voor iedereen individueel. Om deze reden lijkt het verstandig voor onze beschaving om meer tijd en geld te besteden aan het beperken van existentiële risico’s.

Er zijn veel andere problemen die, hoewel momenteel niet de primaire focus van de effectieve altruïsmegemeenschap, plausibele kandidaten zijn om aan te werken en daarmee een grote impact te hebben. Zoals bijvoorbeeld:

· Verbeteringen van de wetenschappelijke gevestigde orde, zoals meer transparantie en replicatie van resultaten

· Onderzoek naar geestelijke gezondheid en neurologische aandoeningen, met name depressie en angst, en verbetering van de toegang tot behandeling in lage-inkomenslanden

· Tabaksregulering

· Amerikaanse hervorming van het strafrecht

· Internationale migratie en hervorming van het handelsbeleid

· Electorale hervorming (bijv. Het implementeren van betere stemmethoden)

Natuurlijk is het waarschijnlijk dat we enkele zeer belangrijke problemen over het hoofd hebben gezien. Dus een manier om een enorme impact te hebben, kan zijn om juist dat probleem te vinden om goed te doen dat bijna iedereen heeft gemist. Daarom is het onderzoek naar hoe schaarse middelen wereldwijd het meest kosten effectief kunnen worden ingezet om de wereld beter te maken (Global priorities research) op zich zelf ook een belangrijk probleemgebied om aan te werken.

Voor de meesten van ons wordt een aanzienlijk deel van onze tijd – gemiddeld meer dan 80.000 uur – besteed aan werk. Dit is een enorme hulpbron die gebruikt kan worden om de wereld beter te maken. Als je je impact met slechts 1% kunt vergroten, staat dat gelijk aan 800 uur extra werk.

80,000 Hours – vernoemd naar de tijd die je met werken doorbrengt – is een non-profitorganisatie die mensen helpt erachter te komen in welke banen ze het meest goed kunnen doen.

Eerst moet je overwegen op welk probleem je je moet concentreren. 80,000 Hours heeft veel suggesties voor problemen waarbij één persoon een substantiële impact kan hebben.

Vervolgens moet je nadenken over de meest effectieve manier om het probleem aan te pakken. Op dit punt is het nuttig om meerdere benaderingen te overwegen. Organisaties die aan deze problemen werken, hebben over het algemeen meer beleidsanalisten, onderzoekers, operationeel personeel en managers nodig. Maar je zou ook meer onconventionele opties kunnen overwegen.

80,000 Hours biedt ook een reeks hulpmiddelen om mensen te helpen beslissingen te nemen. Waaronder hun vacaturebank met veelbelovende carrièremogelijkheden.

Een van de gemakkelijkste manieren waarop je een verschil kan maken, is door geld te doneren aan organisaties die werken aan enkele van de belangrijkste problemen. Geldelijke donaties stellen effectieve organisaties in staat om meer goede dingen te doen en zijn veel flexibeler dan tijddonaties (zoals vrijwilligerswerk).

Veel mensen realiseren zich niet hoe rijk ze relatief gezien zijn. Mensen die professionele salarissen verdienen in landen met een hoog inkomen bevinden zich normaal gesproken in de top 5% van de wereldwijde inkomens. Deze relatieve rijkdom biedt een enorme kans om goed te doen als het effectief wordt gebruikt. (U kunt een schatting krijgen van uw eigen relatieve rijkdom met behulp van deze calculator.)

Met de onderstaande link vind je:

Er is al een groeiende gemeenschap van mensen die de EA ideeën serieus nemen en er naar handelen. Sinds 2009 hebben duizenden en duizenden mensen de 10% Belofte afgelegd. Honderden mensen hebben veranderingen in hun loopbaan doorgevoerd om meer impact te hebben op basis van effectief altruïsme. En er zijn honderden groepen actief voor mensen die geïnteresseerd zijn in effectief altruïsme, waarvan tientallen in Nederland.

Lees meer Lees minder

Wil je op de hoogte blijven van alles wat we doen? Meld je dan aan voor onze nieuwsbrief!